Nvidia hat im dritten Quartal des Fiskaljahres 2024 eindrucksvolle Verkaufszahlen im Bereich der Rechenzentrumshardware erzielt, mit einem Umsatz von 14,5 Milliarden US-Dollar. Ein wesentlicher Anteil dieses Erfolgs ist auf den Verkauf der H100-GPUs für künstliche Intelligenz (AI) und High-Performance-Computing (HPC) zurückzuführen. Laut dem Marktforschungsunternehmen Omdia hat Nvidia beinahe eine halbe Million seiner A100- und H100-GPUs verkauft, und die Nachfrage nach diesen Produkten ist so enorm, dass die Lieferzeiten für H100-basierte Server zwischen 36 und 52 Wochen liegen.

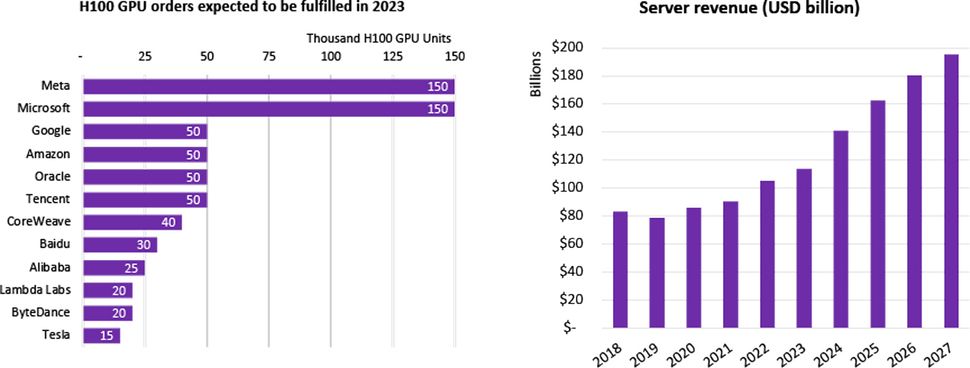

Interessanterweise sind Meta und Microsoft die größten Kunden von Nvidias H100-GPUs. Beide Unternehmen haben jeweils bis zu 150.000 Einheiten erworben, was deutlich mehr ist als die 50.000 H100-Prozessoren, die von anderen großen Playern wie Google, Amazon, Oracle und Tencent gekauft wurden. Es ist bemerkenswert, dass die Mehrheit der Server-GPUs an Hyperscale-Cloud-Service-Anbieter ausgeliefert wird. Server-OEMs wie Dell, Lenovo und HPE können die hohe Nachfrage nach KI- und HPC-GPUs kaum bedienen, so Omdia.

Für das vierte Quartal 2023 prognostiziert Omdia, dass der Verkauf von Nvidias H100- und A100-Compute-GPUs eine halbe Million Einheiten übersteigen wird. Die hohe Nachfrage nach diesen Modellen führt zu langen Wartezeiten von bis zu 52 Wochen für GPU-Server. Trotz eines Rückgangs der Serverlieferungen um 17-20 % im Jahresvergleich für 2023, wird ein Anstieg der Serverumsätze um 6-8 % erwartet.

Ein wichtiger Trend ist, dass viele der Großkunden, die Nvidias H100-GPUs in großen Mengen kaufen, auch eigene kundenspezifische Siliziumlösungen für KI-, HPC- und Video-Workloads entwickeln. Infolgedessen könnten ihre Käufe von Nvidia-Hardware im Laufe der Zeit zurückgehen, da sie zunehmend auf ihre eigenen Chips setzen.

Der Servermarkt selbst ist auf einem beeindruckenden Wachstumspfad und wird bis 2027 auf einen Wert von 195,6 Milliarden US-Dollar geschätzt. Dieses Wachstum wird durch die zunehmende Nachfrage nach Servern angefeuert, die auf spezifische Anwendungen zugeschnitten sind und eine Vielzahl von Co-Prozessoren enthalten. Ein Beispiel hierfür sind Amazons KI-Inferenzserver mit 16 Inferentia 2-Coprozessoren und Googles Videotranskodierungsserver mit 20 kundenspezifischen VCUs. Auch Meta hat mit Servern nachgezogen, die mit 12 spezialisierten Prozessoren für die Videoverarbeitung ausgestattet sind.

Die Tendenz zu benutzerdefinierten, anwendungsoptimierten Serverkonfigurationen dürfte zur Norm werden. Dies liegt an der erkannten Kosteneffizienz beim Bau spezialisierter Prozessoren. Branchen wie Medien und KI sind derzeit führend in dieser Entwicklung, und es ist zu erwarten, dass andere Bereiche wie Datenbankmanagement und Webdienste diesem Trend folgen werden. Diese Verschiebung in Richtung maßgeschneiderter Lösungen könnte langfristige Auswirkungen auf traditionelle Hardware-Anbieter wie Nvidia haben, da sich der Markt zunehmend in Richtung kundenspezifischer Siliziumlösungen bewegt.